Claude Haiku 4.5로 비용 1/5 코딩: Opus 대신 써야 할 때는 언제?

Claude Haiku 4.5 사용법 한 줄 요약

Opus급 긴 추론이 꼭 필요한 작업이 아니라면,

claude haiku 4.5 사용법은 생각보다 단순해요. Claude Platform 기준 단가는 입력$1, 출력$5라서 Opus 4.5·4.6 계열의$5/$25보다 정확히1/5이고, Claude Code에서는/model haiku나claude --model haiku로 바로 내려 쓸 수 있거든요. 대신 긴 파일을 통째로 다시 짜거나, 아키텍처를 새로 정하거나, 꼬인 버그를 끝까지 파는 일은 Sonnet이나 Opus를 남겨두는 편이 안전해요.

결론부터. 2026년 4월 18일 기준으로 claude haiku 4.5 사용법을 찾는 사람이 제일 헷갈려하는 건 성능 자체보다 경계선이에요. 싸다는 말은 많은데, 진짜로 어디까지 내려 써도 안 터지는지 잘 안 보이거든요. 저도 처음엔 Opus나 Sonnet에서 바로 Haiku로 내리면 결과물이 얕아질 줄 알았어요. 근데 diff 읽기, 테스트 초안, 로그 분류, 반복 배치 작업은 생각보다 잘 버텼고, 반대로 긴 함수 한 번에 다시 짜기나 꼬인 디버깅은 아직 큰 모델 쪽이 손이 덜 가더라고요. 그래서 이 글은 가격표부터 들이미는 대신, 먼저 어디까지 맡겨도 되는지부터 자를게요. 그다음 Claude Code에서 바로 바꾸는 명령어, Batch API와 Prompt Caching으로 비용 깎는 법, Gemini 3 Flash Preview랑 비교했을 때 어디가 다른지까지 순서대로 묶었어요. 자동 위임 흐름이 궁금하면 Claude Code 서브에이전트 만들기 실전 가이드: 자동 위임·비용 절감 세팅까지도 같이 보면 좋아요. 청구서 줄이는 건 쉬워요. 근데 모델 분배 기준을 못 세우면 검수 시간이 다시 늘어요. 그 선부터 여기서 잡아두면 돼요.

Claude Haiku 4.5, 어디까지 맡겨도 되나

이 섹션은 Haiku 4.5를 어떤 일에 먼저 붙이면 손해가 적은지 빠르게 가르는 기준이에요.

공식 포지셔닝과 실무 경계

굳이 큰 모델부터 누를 필요 없어요. Anthropic 공식 소개 페이지는 Haiku 4.5가 코딩, computer use, agent 작업에서 Sonnet 4 수준에 맞먹는다고 적어요. 여기서 computer use는 브라우저나 앱 화면을 직접 눌러가며 작업하는 쪽을 말해요. 근데 실무에서 중요한 건 벤치 숫자보다 “내 작업이 어느 쪽이냐”죠. claude haiku 4.5 사용법을 묻는 분들도 대개 이 경계선에서 막히거든요.

코드베이스를 읽고, 고치기 전에 어디를 봐야 할지 정리하고, 테스트 초안을 뽑고, 반복 작업을 병렬로 던지는 쪽은 Haiku가 꽤 잘 맞아요. 반대로 요구가 애매하고, 한 번에 건드리는 파일 수가 많고, 중간중간 판단을 바꿔야 하는 작업은 Sonnet이나 Opus가 여전히 편해요.

| 작업 종류 | Haiku 4.5에 먼저 붙여볼 일 | Sonnet/Opus를 남겨둘 일 |

|---|---|---|

| 코드 읽기 | diff 요약, 로그 분류, 코드 검색, 테스트 후보 뽑기 | 코드베이스 전체 설계 다시 짜기 |

| 코드 쓰기 | 짧은 함수 수정, 리팩터링 초안, 문서/주석 정리 | 긴 파일 통째로 재작성 |

| 에이전트 운영 | 병렬 executor, 반복 배치, 서브태스크 분산 | 최종 통합, 어려운 판단, 실패 원인 추론 |

| 속도/비용 | 빠름, 비용 낮음 | 느리지만 결정력이 더 안정적 |

| 추천 시작점 | 읽기 중심 태스크 | 설계 중심 태스크 |

Haiku에 먼저 넘겨본 작업 3개

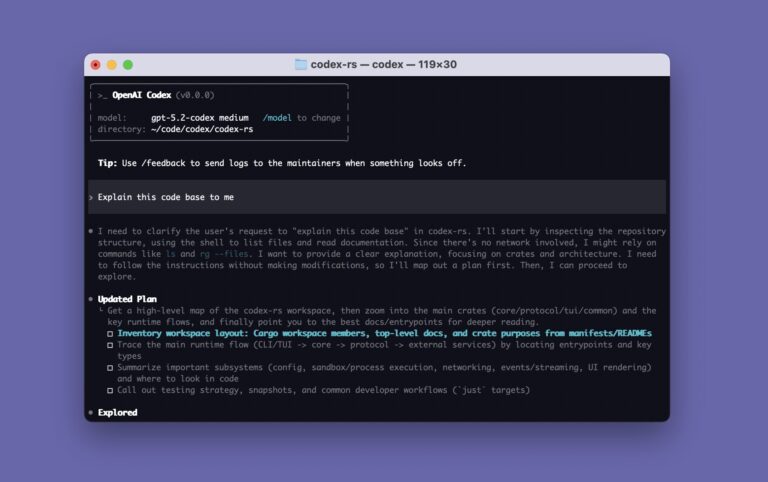

공식 문서 기준으로 Claude Code의 built-in Explore 서브에이전트도 Haiku 계열로 돌아가요. 읽기 전용 탐색을 Haiku에 먼저 맡기고, 마지막 결정만 큰 모델로 넘기는 흐름이 자연스러운 이유가 여기 있어요. 더 무거운 추론이 필요한 패턴은 Claude Opus 4.7 코딩 활용법: xhigh와 비전 업그레이드로 바뀐 실전 워크플로우 쪽이 더 잘 맞아요.

저도 이 구분을 한동안 계속 헷갈렸어요. 제일 먼저 붙여서 괜찮았던 태스크 3개를 적어둘게요. 첫째, 긴 PR diff 한 덩어리를 10줄 요약으로 줄이는 작업은 Haiku에 바로 넘겨도 거의 매번 잡아냈어요. 둘째, 테스트 이름과 대상 함수를 적어주고 pytest 케이스 초안 5개 뽑는 작업도 Haiku 쪽이 충분했어요. 셋째, 서비스 로그를 에러/경고/정보로 분류하고 상위 패턴만 뽑는 반복 작업도 Haiku가 편했어요. 반대로 “이 버그 왜 나는지 원인까지 짚어줘” 같은 질문은 Sonnet 이상으로 올리는 편이 재작업이 적어요.

Claude Haiku 4.5 가격, 진짜 얼마인가

가격은 단가만 보면 끝날 것 같지만, 입력과 출력, 배치 할인, 캐시 적중까지 같이 봐야 체감이 맞아요.

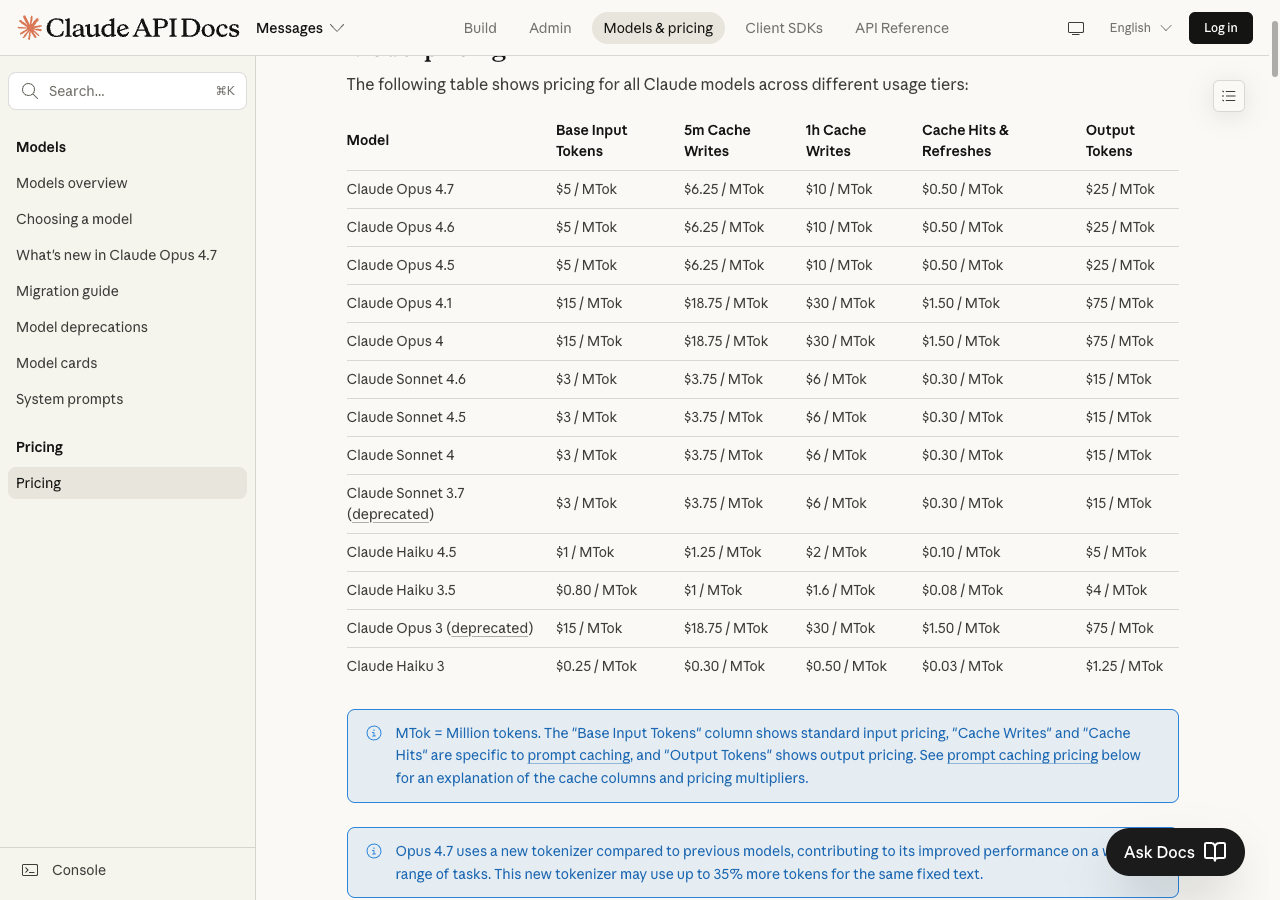

2026년 4월 18일 기준 Claude Platform 공식 가격은 간단해요. Haiku 4.5는 입력 1M 토큰당 $1, 출력 1M 토큰당 $5예요. Sonnet 4.5·4.6은 $3 / $15, Opus 4.5·4.6은 $5 / $25라서, Opus 기준으로는 정확히 1/5이고 Sonnet 기준으로는 1/3 수준인 셈이죠.

| 모델 | 입력 1M 토큰 | 출력 1M 토큰 | 100회 시나리오 총액* |

|---|---|---|---|

| Claude Haiku 4.5 | $1.00 | $5.00 | $2.00 |

| Claude Sonnet 4.5/4.6 | $3.00 | $15.00 | $6.00 |

| Claude Opus 4.5/4.6 | $5.00 | $25.00 | $10.00 |

| Claude Haiku 4.5 Batch | $0.50 | $2.50 | $1.00 |

* 가정: 요청 100회, 매회 입력 1만 토큰 / 출력 2천 토큰

여기서 끝이 아니에요. Prompt Caching, 그러니까 공통 입력을 다시 계산하지 않게 하는 캐시를 얹으면 숫자가 더 내려가요. 공통 프리픽스 8천 토큰이 99번 재사용되는 식이면 Haiku Batch 기준 총액이 대략 $0.64 근처까지 떨어져요. 이 계산은 캐시 쓰기 1.25배, 캐시 읽기 0.1배를 가정했어요. 여기에 Batch 50% 할인까지 같이 넣은 값이에요. Opus 표준 $10이던 작업이 $0.64면 약 93.6% 절감이죠. 출력이 더 짧고 반복 입력이 더 길면 95% 근처도 보일 수 있어요.

비용표만 보는 것보다, 어떤 일을 어디로 보낼지 먼저 정해두는 쪽이 훨씬 잘 먹혀요. 반복 작업을 여러 갈래로 쪼개는 구조 자체가 더 궁금하면 본문 앞에서 이미 소개한 서브에이전트 가이드를 같이 보면 흐름이 빠르게 잡혀요.

Claude Code Haiku 모델 변경, 여기서 끝내기

Claude Code 안에서 Haiku로 바꾸는 건 복잡하지 않아요. 모델 바꾸기 자체는 1분도 안 걸리는데, 어디서 막히는지만 미리 알면 삽질을 많이 줄여요.

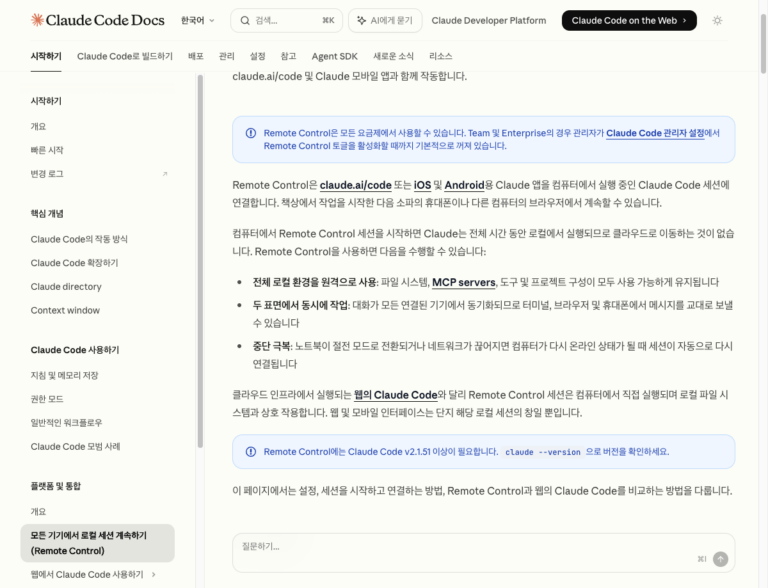

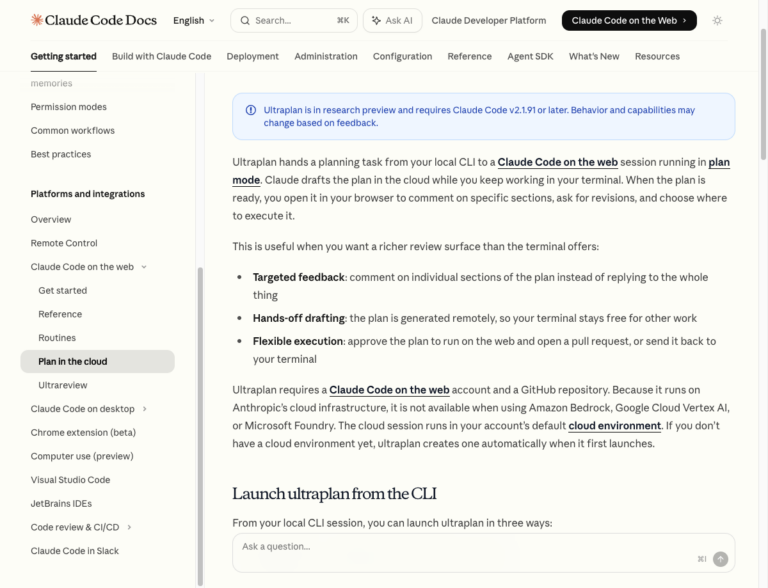

공식 도움말 기준으로 Claude Code는 세션 안에서 /model로 바로 바꿀 수 있고, /status로 현재 모델을 볼 수 있어요. 지원 모델 목록에도 Haiku 4.5가 명시돼 있고, 전체 모델 ID는 claude-haiku-4-5-20251001으로 적혀 있어요. 세션 시작부터 고정하고 싶으면 --model 플래그를 쓰면 돼요. 자주 헷갈리는 포인트라 한 번 더 적어둘게요.

# Claude Code 세션 안에서

/status

/model

/model haiku

# 세션 시작부터 하이쿠로 열기

claude --model haiku

아예 모델별로 쓰임새를 나눠두는 것도 가능해요.

haiku: 빠른 읽기, 짧은 수정, 반복 실행sonnet: 매일 쓰는 기본 코딩opus: 긴 추론이나 어려운 판단opusplan: 계획 단계는 Opus, 실행은 Sonnet으로 분리

여기서 실전 팁 하나. 공식 문서 기준 Explore 서브에이전트는 Haiku로 돌아가요. 그래서 코드베이스 탐색, 파일 찾기, 구조 파악 같은 읽기 중심 작업부터 Haiku로 내려 쓰는 흐름이 가장 덜 어색해요. 모델 전환 기본 동선이 낯설면 Claude Code 사용법: 설치부터 첫 실행까지 5분 가이드부터 먼저 보고 오면 금방 적응돼요.

서드파티 통합 쪽은 조금 다르게 봐야 해요. 2026년 4월 18일 기준으로 이미 올라온 이슈를 보면, VS Code Copilot Chat에서는 Haiku 4.5를 쓸 때 같은 요청을 반복하다 멈추는 endless loop 리포트가 열려 있고, Windows에서 Claude Code의 /advisor 슬래시 명령이 Haiku 4.5에 executor 권한을 거절하는 이슈도 아직 수정 중이에요. 반면 KiloCode의 Haiku 4.5 tool use 오류는 재현 불가로 닫혔어요. 그래서 에디터나 IDE 안에서 Haiku를 돌리기 전엔 내가 쓰는 환경에서 간단한 태스크로 먼저 재현을 확인하는 편이 안전해요.

커뮤니티에선 Haiku 세션에 plan mode를 섞어 planning/execute를 나누는 패턴도 많이 써요. 근데 이건 계정 타입이랑 현재 버전 영향을 꽤 타더라고요. 먼저 짧은 태스크 하나로 직접 돌려보고 믿는 게 맞아요.

Haiku 4.5 Sonnet 차이, 어디서 갈리나

Haiku가 생각보다 잘 버티는 구간은 분명 있어요. 그렇다고 Sonnet 자리를 전부 밀어내는 건 아직 아니에요. 왜 그럴까요?

공식 문구와 태스크별 선택표

공식 Haiku 4.5 페이지는 Sonnet 4 수준의 코딩, computer use, agent 성능을 강조해요. 여기서 포인트는 Sonnet 4 수준이지, Sonnet 4.5나 Opus까지 다 대체는 아니라는 점이에요. 그래서 읽기와 실행 쪽은 Haiku, 애매한 판단과 긴 설계는 Sonnet 이상으로 나누는 게 현실적이에요.

| 태스크 | 먼저 고를 모델 | 이유 |

|---|---|---|

| diff 읽고 수정 포인트 찾기 | Haiku 4.5 | 빠르고 싸고, 맥락 탐색에 강함 |

| 테스트 케이스 초안 만들기 | Haiku 4.5 | 실패해도 재시도가 싸요 |

| 반복 리팩터링 병렬 실행 | Haiku 4.5 | executor 역할에 잘 맞음 |

| 긴 함수 여러 개를 한 번에 다시 쓰기 | Sonnet 4.5/4.6 | 중간 판단이 바뀌어도 맥락을 끝까지 끌고 가요 |

| 꼬인 버그 원인 찾기 | Sonnet 4.5/4.6 | 추론 유지력이 더 안정적 |

| 설계 방향 새로 정하기 | Opus | 가장 비싼 대신 결론이 단단한 편 |

코드 양보다 정답 범위가 기준

실제로는 “코드를 많이 쓴다 = 결과가 좋다”가 아니더라고요. Haiku가 빠르게 많이 뽑는 순간도 있는데, 그만큼 사람이 다시 자르는 시간이 붙으면 이득이 줄어요. 반대로 코드 분석, 변경 범위 요약, 테스트 보강처럼 정답 범위가 좁은 일은 Haiku가 꽤 안정적이에요. 장시간 자율 코딩 쪽 상위 모델 감각은 Claude Opus 4.7 코딩 활용법: xhigh와 비전 업그레이드로 바뀐 실전 워크플로우에서 이어서 보면 좋아요.

간단히 정리하면 이래요.

- Haiku 4.5: 빠른 읽기, 짧은 수정, 반복 실행

- Sonnet 4.5/4.6: 복잡한 코딩의 기본값

- Opus: 어려운 판단, 긴 설계, 막힌 문제의 탈출구

본인 기준으로 남겨보면 이래요. Haiku에 그대로 둬도 좋았던 작업은 README 링크 체크와 마크다운 문법 정리, PR 라벨 후보 뽑기 두 가지였어요. 반대로 Sonnet으로 되돌린 작업은 여러 서비스가 얽힌 500 에러 원인 추적, 그리고 Python 테스트에서 flaky로 의심되던 케이스 뿌리 찾기였어요. 전자는 결과가 짧고 답 범위가 좁아서 Haiku가 일관됐고, 후자는 중간에 가설이 두 번 이상 바뀌는 구간에서 Haiku가 이전 결론을 자주 놓쳤어요.

Batch API와 Prompt Caching으로 비용 더 깎기

반복 태스크가 많으면 여기서 비용 차이가 진짜 벌어져요. 요청을 하나씩 실시간으로 보내고 있다면, 여기서 절반을 바로 깎을 수 있어요.

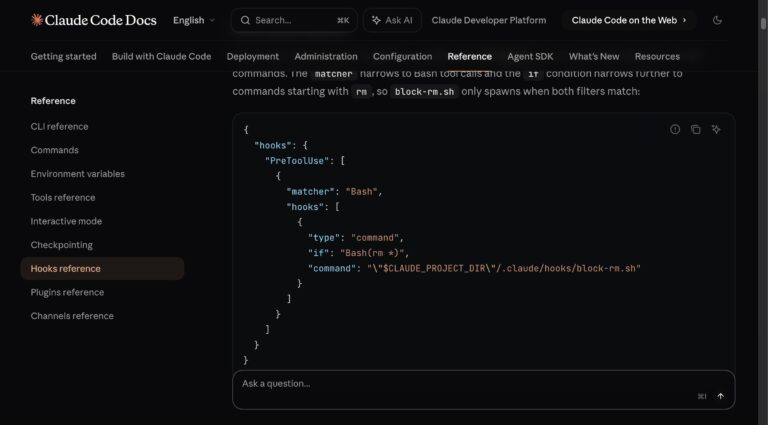

Batch API는 요청을 묶어서 비동기로 돌리는 방식이고, 공식 가격표 기준 입력과 출력 모두 50% 할인돼요. Prompt Caching은 같은 시스템 프롬프트나 공통 문서를 계속 다시 읽지 않게 만드는 캐시예요. Haiku 4.5는 최소 캐시 길이가 4,096 토큰이라서, 짧은 시스템 프롬프트 하나만 던지면 기대한 절감이 안 나와요.

아래 흐름으로 잡으면 편해요.

- 공통 규칙, 스타일 가이드, 긴 레퍼런스 문서를 한 묶음으로 고정

- 반복 요청은 Batch API로 제출

- 출력이 짧은 태스크에 먼저 Haiku 적용

- 복잡한 문제만 thinking을 켜고, 기본은 끄기

- 결과물은 사람이 샘플링 검수

# 반복 작업을 배치로 제출

python pipeline/batch_runner.py \

--model claude-haiku-4-5-20251001 \

--jobs data/review_jobs.jsonl \

--out out/review_results.jsonl

from anthropic import Anthropic

client = Anthropic()

batch_requests = [

{

"custom_id": "review-001",

"params": {

"model": "claude-haiku-4-5-20251001",

"max_tokens": 800,

"cache_control": {"type": "ephemeral"},

"system": "You review diffs and return a short Korean checklist.",

"messages": [

{"role": "user", "content": diff_text}

],

},

}

]

job = client.beta.messages.batches.create(requests=batch_requests)

print(job.processing_status)

# 출력 예시: in_progress

중요한 함정도 하나 있어요. 2026년 4월 기준 automatic caching, 그러니까 요청 맨 위에 cache_control 하나만 두는 방식은 Claude API와 Azure AI Foundry 미리보기에서 먼저 열려 있고, Amazon Bedrock이랑 Google Vertex AI는 공식 문서에 later로 적혀 있어요. 클라우드 플랫폼만 바꿔도 동작이 같을 거라고 생각하면 여기서 많이 헷갈려요.

반복 요청이 많은 콘텐츠 파이프라인 예시는 AI 블로그 브리프 자동 생성: 실전 파이프라인 구축기랑도 결이 비슷해요. 공통 문맥을 길게 잡아놓고, 마지막 질문만 바꾸는 구조일수록 Haiku가 잘 먹혀요.

Gemini 3 Flash와 비교하면 뭐가 다를까

순수 토큰 단가만 보면 Gemini 3 Flash가 더 싸게 보여요. 그런데 쓸 수 있는 환경이랑 코딩 워크플로우 붙는 방식까지 보면 얘기가 조금 달라져요.

환경 커버리지부터 다르게 퍼져 있어요

2026년 4월 18일 기준 공식 문서 흐름을 기준으로 정리하면, Gemini 3 Flash는 아직 Preview 표기가 붙어 있어요. Google 쪽은 Gemini 앱, 검색 안의 AI Mode, Gemini API, Google AI Studio, Gemini CLI, Android Studio, Google Antigravity, Vertex AI, Gemini Enterprise로 넓게 퍼져 있어요. Haiku 4.5 쪽은 Claude.ai 웹/iOS/Android, Claude Code, Chrome 확장으로 붙는 Claude in Chrome, Claude Platform API, Bedrock, Vertex AI, Azure 위에서 모델을 호스팅하는 Microsoft Foundry까지 들어가 있고, GitHub Copilot 쪽도 Chat/CLI/모바일/VS Code/Visual Studio/JetBrains/Xcode/Eclipse까지 이미 풀렸어요. 단가만 볼까요, 아니면 내가 붙여 쓸 환경까지 볼까요?

| 항목 | Claude Haiku 4.5 | Gemini 3 Flash Preview |

|---|---|---|

| 공식 단가 | Claude Platform 기준 $1 / $5 |

Gemini API 기준 $0.50 / $3 |

| Batch/Flex 계열 | Batch 기준 $0.50 / $2.50 |

Vertex AI Flex/Batch 기준 $0.25 / $1.50 |

| 컨텍스트 | 200K / 64K |

1M / 64K |

| 일반 사용자 앱 | Claude.ai 웹, iOS, Android, Claude in Chrome | Gemini 앱, Search의 AI Mode |

| 개발자 환경 | Claude Code CLI/desktop/VS Code/JetBrains/web/mobile, Claude API, Bedrock, Vertex, Foundry, GitHub Copilot 전반 | Gemini API in AI Studio, Gemini CLI, Android Studio, Google Antigravity, Vertex AI, Gemini Enterprise |

| 코딩 워크플로우 성격 | Claude Code, Explore, sub-agent, computer use 흐름이 강함 | Search, File Search, Code Execution, URL Context 같은 built-in tool 폭이 넓음 |

| 추천 상황 | Claude Code 중심, 빠른 executor, 다중 에이전트 | 긴 컨텍스트, 더 낮은 토큰 단가, Google 생태계 중심 |

결정 기준은 “이미 어디 올라타 있나”

순수 가성비만 보면 Gemini 3 Flash가 더 공격적이에요. 반대로 Claude Code를 중심으로 돌리고 있거나, sub-agent 분배와 computer use 흐름까지 같이 쓰고 싶으면 Haiku 4.5가 붙는 맛이 있어요. IDE 안 모델 선택 감각은 GitHub Copilot vs Claude Code: 가격부터 실사용까지 비교도 같이 보면 흐름이 빨리 잡혀요.

자주 묻는 질문

Q1. Haiku 4.5가 Sonnet만큼 코딩이 정말 되나요?

A: 공식 소개 페이지는 Sonnet 4 수준의 코딩, computer use, agent 작업을 말해요. 근데 복잡한 설계나 꼬인 디버깅까지 같은 급이라고 보긴 아직 어려워요. 읽기, 테스트, 반복 실행은 Haiku로 보내고 마지막 판단은 Sonnet 이상으로 남기는 편이 안전해요.

Q2. Claude Code에서 Haiku 4.5는 /model haiku만 치면 되나요?

A: 네. 공식 도움말 기준으로 세션 안에서는 /model이나 /model haiku를 쓰면 되고, 새 세션 시작부터 고정하려면 claude --model haiku를 쓰면 돼요. 현재 모델은 /status로 보면 돼요.

Q3. Batch API 50% 할인 적용하면 Haiku 4.5는 실제로 얼마예요?

A: 공식 가격표 기준으로 입력은 1M 토큰당 $0.50, 출력은 1M 토큰당 $2.50이에요. 여기에 Prompt Caching까지 얹으면 반복 입력이 큰 작업에서 체감 비용이 더 내려가요.

Q4. Extended Thinking 비용은 따로 싸게 붙나요?

A: 아니에요. 공식 extended thinking 문서는 thinking 토큰이 출력 토큰으로 과금된다고 적어요. 그래서 쉬운 태스크에 thinking을 켜두면 오히려 Haiku를 쓰는 의미가 줄 수 있어요.

Q5. Gemini 3 Flash가 더 싸고 컨텍스트도 긴데 왜 Haiku 4.5를 쓰나요?

A: 토큰 단가와 컨텍스트만 보면 Gemini 3 Flash 쪽이 매력적이에요. 근데 Claude Code, sub-agent, computer use, GitHub Copilot 쪽까지 붙는 코딩 워크플로우는 Haiku 4.5가 더 자연스러워요. 이미 Claude 쪽 도구에 올라타 있다면 옮기는 비용도 같이 봐야 해요.

다음 단계

오늘은 /model haiku로 먼저 하루만 써보세요. 모델 전환부터 다시 잡고 싶으면 Claude Code 5분 셋업로 가고, 자동 위임까지 붙일 거면 Claude Code 서브에이전트 만들기 실전 가이드: 자동 위임·비용 절감 세팅까지로 바로 넘어가면 돼요.