프로그래매틱 SEO로 AI가 수천 페이지 찍어내기 — 실전 워크플로

프로그래매틱 SEO AI 한 줄 요약

짧은 답: 프로그래매틱 SEO AI는 아직 됩니다. 근데 실재 데이터 없이 제목 변수만 바꾼 페이지를 한 번에 쏟아내면, 구글이 보는 건 AI 사용 여부보다 가치 부족과 대량 생성 패턴이거든요. 1인 운영자라면

데이터셋 준비 → 초안 생성 → 5~10% 샘플 검수 → 50개 배치 발행 → 2주 관찰순서로 가는 쪽이 훨씬 안전해요.

하룻밤에 수천~수만 페이지를 찍어낸 뒤 2026년 3월 스팸 업데이트에서 대부분의 트래픽을 잃은 사례가 공유된 뒤부터 분위기가 완전히 바뀌었어요. 예전엔 “많이 만들면 이긴다” 쪽에 가까웠는데, 2026년 들어서는 “왜 이 페이지가 존재해야 하죠?”를 먼저 못 답하면 바로 밀리더라고요.

프로그래매틱 SEO AI도 똑같아요. 자동화 자체가 문제가 아니라, 행(row)마다 다른 판단 재료가 있느냐가 핵심이거든요. 특히 1인 운영자는 상용 툴 데모만 보고 들어갔다가, 막상 데이터셋 연결이나 CMS 발행에서 돈만 쓰고 흐름이 꼬이기 쉬워요. 여기서는 그 지점을 줄이려고 했어요. 어떤 패턴이 먼저 터지는지, 구글이 말하는 대량 생성형 검색 조작인 scaled content abuse와 어디서 갈리는지, 그리고 Claude Code와 n8n으로 어느 정도까지는 직접 굴릴 수 있는지 순서대로 잡아볼게요. 숫자는 크게 불리지 않았어요. 대신 첫 배치 50개를 어떻게 올리고, 뭘 보고, 언제 멈출지 쪽에 무게를 뒀습니다.

실패 사례로 먼저 보는 위험 패턴

대량 생성이 터지는 이유는 생각보다 단순해요. 데이터가 빈약한데 발행 속도만 빠르면, 페이지 수가 아니라 패턴이 먼저 들키거든요.

| 사례 유형 | 공통 문제 | 바로 배울 점 |

|---|---|---|

| SaaS 랜딩페이지 일괄 발행 | 템플릿 반복, 수동 검수 부족 | 첫 배치를 작게 끊어야 해요 |

| 여행형 지역 페이지 대량 생성 | 지역명만 바뀌고 본문 구조는 거의 같음 | 변수 치환만으로는 못 버텨요 |

| 2026년 3월 스팸 업데이트 직격 사이트 | 가치가 약한 대량 페이지, 링크 조작 패턴 동반 | AI 여부보다 품질과 의도가 먼저 걸려요 |

실패한 페이지를 보면 공통점이 꽤 선명해요. 첫 문단, FAQ, 후기 블록, 내부 링크 블록까지 거의 복붙인 경우가 많았고, 실제로 다른 건 지명 한 단어인 셈이죠. 검색엔진이 “페이지 수가 많다”만 보고 자르는 게 아니라는 얘기는 구글 2026 코어 업데이트 대응: 회복한 블로그의 공통점 분석 쪽 흐름이랑도 맞닿아 있어요.

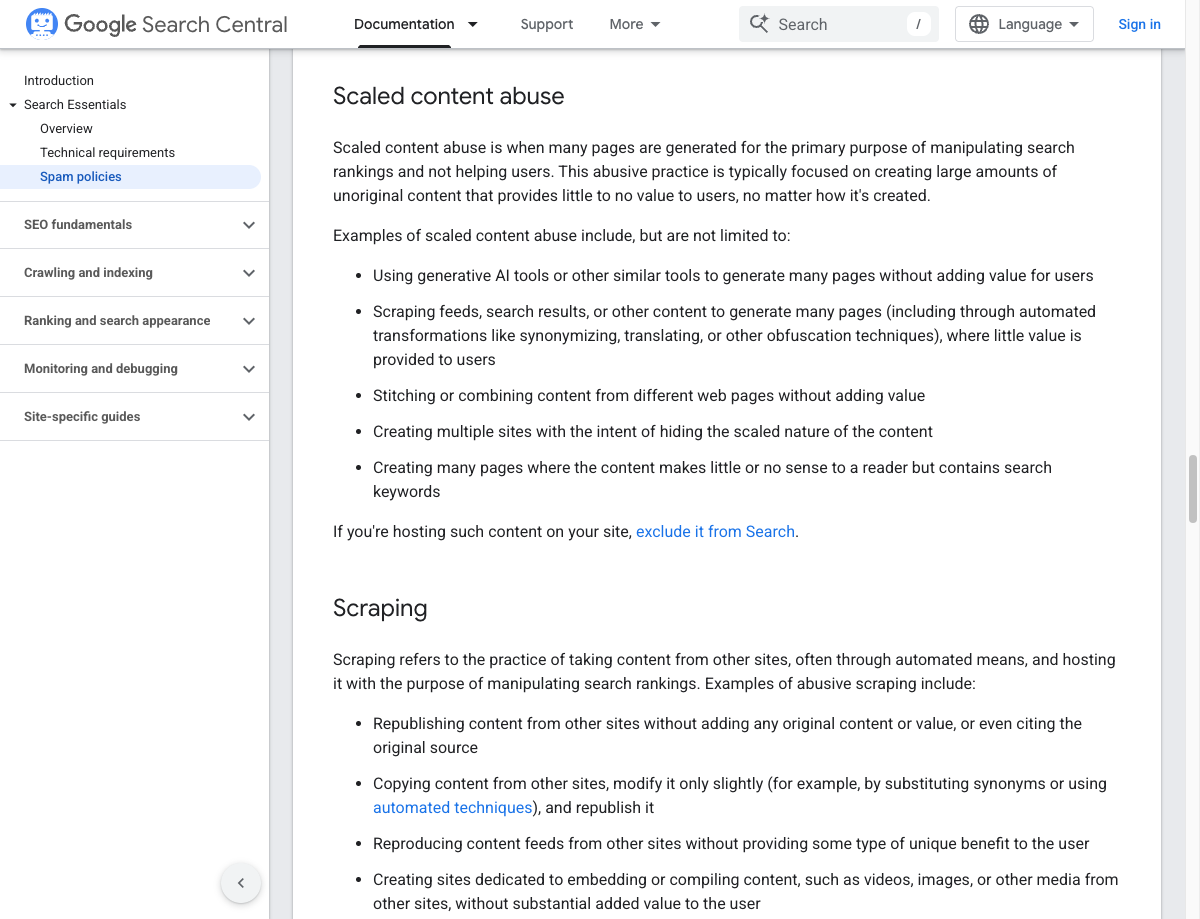

프로그래매틱 SEO AI와 AI 스팸의 차이

이 구간은 헷갈리기 쉬워요. 프로그래매틱 SEO AI는 데이터를 바탕으로 페이지를 늘리는 방식이고, AI 스팸은 검색 결과만 노리고 가치 없이 대량 생성하는 쪽에 가까워요. 둘은 결과물이 비슷해 보여도, 구글이 보는 지점이 달라요. 근데 경계가 흐리면 어떡하냐고요?

구글 공식 문서 기준으로 포인트는 의외로 직설적이에요. 생성형 AI를 쓰는 것 자체보다, 사용자에게 가치 없는 페이지를 많이 만드는 게 문제라는 쪽이죠. 그래서 아래 체크가 안 되면 프로그래매틱 SEO AI라고 부르기 어렵고, 그냥 얇은 자동 생성에 가까워져요.

- 각 페이지가 서로 다른 질문에 답하나요

- 행마다 다른 사실 데이터가 있나요

- 페이지를 읽은 뒤 독자가 행동을 바꿀 이유가 있나요

- 사람이 뽑아본 샘플에서 어색한 문장과 헛소리가 걸러지나요

실무에서 더 헷갈리는 건 “토픽 권위가 먼저냐, 대량 페이지가 먼저냐”예요. 데이터가 빈약하면 클러스터형 주제 운영이 더 나을 때가 많아요. 그 판단은 토픽 권위 블로그 구축: 클러스터 전략으로 트래픽 30배 키우기 쪽 기준으로 먼저 나눠보면 덜 틀립니다.

살아남는 페이지의 세 가지 조건

프로그래매틱 SEO AI에서 살아남는 페이지는 체크리스트로 보는 게 빨라요. 독자적 데이터, 페이지 간 고유성, 그리고 작은 배치 운영. 셋 중 하나라도 빠지면 초반엔 올라가도 오래 못 가더라고요. 왜 굳이 이렇게 답답하게 가야 할까요?

1. 독자적 데이터가 있어야 해요

같은 키워드라도 내 페이지에만 있는 행 데이터가 있어야 해요. 가격, 재고, 지역별 규칙, 비교 기준, 실측값, 실제 사례 요약 같은 거죠. 이게 없으면 제목만 늘어난 페이지가 됩니다.

2. 페이지끼리 진짜로 달라야 해요

커뮤니티와 업계 가이드에서 자주 나오는 경험칙이 “30~40%는 페이지별로 달라야 한다”예요. 이 수치는 구글 공식 규칙은 아니에요. 다만 문단 구조, FAQ, CTA, 비교 포인트까지 다 똑같으면 위험하다는 실무 감각은 꽤 일관됐어요.

3. Google Search Console(GSC)로 2주씩 끊어 봐야 해요

배치 운영은 멋이 아니라 보험이에요. 한 번에 500개 올리면 뭐가 문제였는지 역추적이 안 됩니다. 50개만 먼저 올리고 색인율, 노출수, 신규 쿼리, 비정상 탈락 URL을 보는 편이 훨씬 낫죠.

| 주차 | 발행 수 | 꼭 볼 지표 | 멈추는 기준 |

|---|---|---|---|

| 1주차 | 50 | 색인율, 노출수, 브랜드 외 쿼리 유입 | 비정상 미색인 다수 |

| 3주차 | 50 | URL별 노출 편차, 템플릿 중복 냄새 | 유사 페이지 동시 침체 |

| 5주차 | 100 | 배치 간 성과 차이, 내부 링크 확장 효과 | 새 배치가 이전 배치 잠식 |

스키마 마크업은 이걸 대신해주진 않아요. 근데 서로 다른 데이터를 기계가 읽기 쉽게 정리하는 데는 도움이 됩니다. 자동 주입 쪽은 AI Schema 만들기: Article·FAQ·Breadcrumb JSON-LD 자동 생성 가이드랑 같이 묶어 두는 게 편해요.

도구 비교: AirOps·Byword·SEOmatic·n8n·Claude Code

프로그래매틱 SEO AI 도구는 기능표만 보면 다 좋아 보여요. 문제는 어디서 쓰느냐예요. 웹 앱만 쓰는지, CMS까지 바로 붙는지, API나 IDE 확장이 있는지에 따라 운영 방식이 확 갈립니다. 혼자 돌릴 건데 엔터프라이즈 툴 감성에 휘둘릴 필요 있을까요?

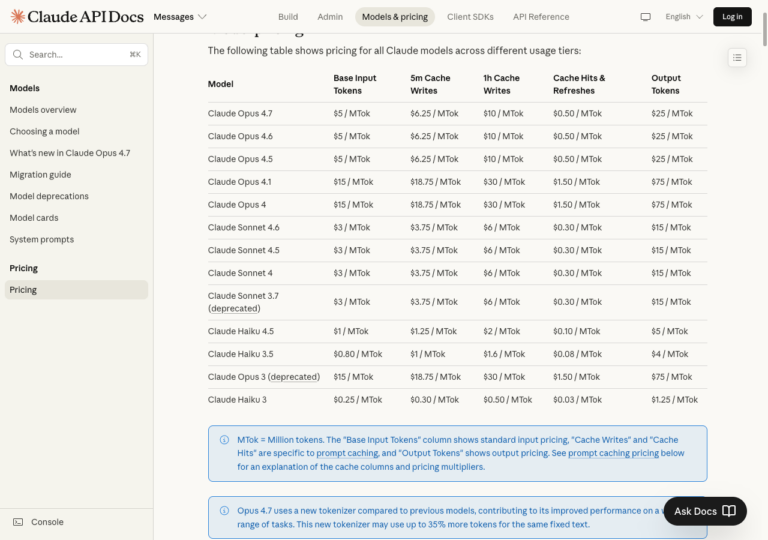

2026년 4월 기준 다섯 도구 요약표

아래 표는 2026년 4월 18일 기준 공식 사이트에서 확인된 쓸 수 있는 환경과 가격만 넣었어요.

| 도구 | 공식 확인된 쓸 수 있는 환경 | 공식 가격 (월 기준) | 대량 생성/데이터셋 | 발행 경로 | 1인 운영자 판단 |

|---|---|---|---|---|---|

| AirOps | 웹 앱, API, JS SDK, Claude Connector(웹/데스크톱), Claude Code용 MCP, CMS 연동 | Insights $0부터, Pages는 Custom | 워크플로·브랜드킷·콘텐츠 제작 강함 | WordPress, Webflow 등 CMS 직접 연동 | 예산 예측이 가장 어렵고, 협업 팀에 더 잘 맞아요 |

| Byword | 웹 앱, WordPress/Webflow, API, Zapier, CSV export | Starter $99(월 25글), Standard $299(80), Scale $999(300), Unlimited $1,999 | 캠페인·프로그램매틱 빌더 있음 | WordPress 직접, 다른 도구는 Zapier/CSV 경유 가능 | 빠른 발행은 좋은데 상시 대규모 운영은 비용이 빨리 커져요 |

| SEOmatic | 웹 앱, 25+ CMS 연동, CSV/Google Sheets import, 자체 호스팅 옵션, 상위 플랜 API | Launch $149, Scale $399, Infrastructure $899 | 전형적인 프로그램매틱 SEO용 구조 | WordPress, Webflow, Shopify 등 대량 발행 | 대량 페이지 구조가 제일 명확해요 |

| n8n | 클라우드 웹, 셀프호스팅 웹, 1000+ integrations | Starter €20, Pro €50, Business €667 (연간 기준) | 데이터 흐름 조립에 강함 | WordPress, Sheets, Anthropic 등 자유 연결 | 혼자 운영하기엔 제일 유연해요 |

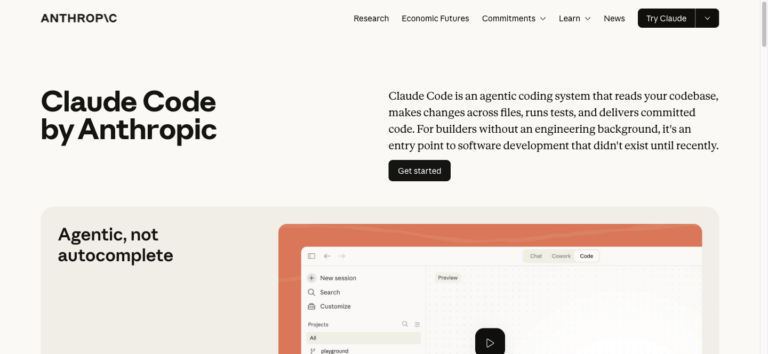

| Claude Code | 터미널 CLI, VS Code/Cursor, JetBrains | Pro $20, Max 5x $100, Max 20x $200, 필요시 API 종량제 | 데이터 정리, 템플릿 생성, 검수 자동화 강함 | 직접 CMS는 아님, MCP와 스크립트로 연결 | 직접 짜는 수고를 감수하면 가장 강력해요 |

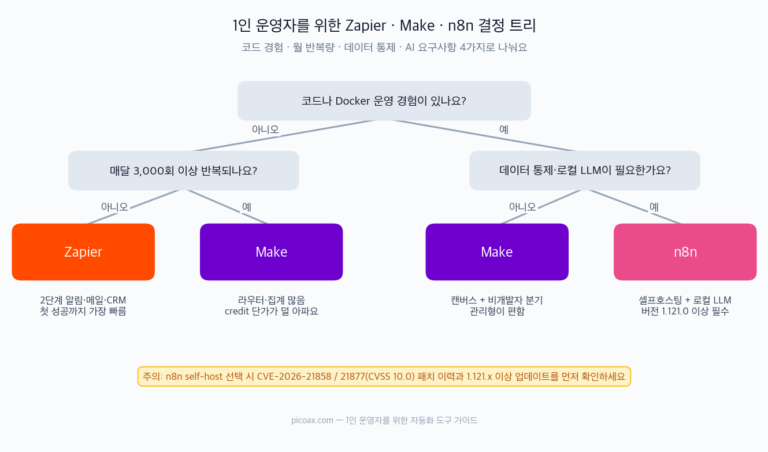

1인 운영자 기준으로 갈라지는 지점

제가 보기엔 월 50~100페이지면 n8n + Claude Code 조합이 가장 현실적이에요. 반대로 이미 Webflow나 Shopify 컬렉션 구조가 크고, 페이지 타입이 반복적이라면 SEOmatic이 시간을 많이 줄여줘요. 내부 링크를 자동으로 붙이는 단계까지 가면 블로그 내부링크 자동화: 규모별 도구 비교와 검수 워크플로우도 같이 봐두는 게 좋아요.

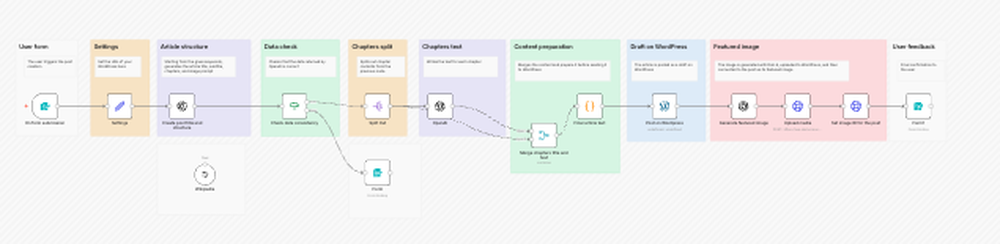

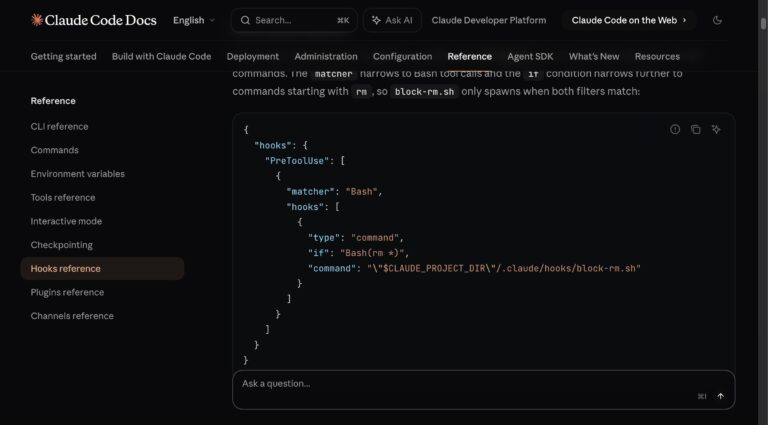

Claude Code와 n8n으로 배치 발행하기

프로그래매틱 SEO AI를 직접 굴리려면 사람이 꼭 잡아야 하는 구간과 자동화해도 되는 구간을 나눠야 해요. 키워드 조사, 데이터 정리, 초안 생성, 표본 검수, 발행 예약. 이 순서만 안 꼬이면 생각보다 안정적으로 돌아갑니다. 첫날부터 500개 예약을 거는 쪽은 피해야 하고요.

전체 흐름은 이렇게 잡으면 됩니다.

- 시드 키워드를 모아요.

- 키워드마다 붙일 실제 데이터 열을 만듭니다.

- Claude Code로 템플릿 초안을 찍어요.

- 5~10%를 사람이 읽고 잘라냅니다.

- n8n으로 WordPress REST API에 배치 발행을 걸어요.

# 시드 키워드에서 데이터셋 만들기

./pipeline/seed-to-dataset.sh --input keywords.csv --out dataset.json

# 데이터셋으로 초안 생성

./pipeline/dataset-to-drafts.sh --dataset dataset.json --template service-city.md

# 10% 샘플만 먼저 검수

./pipeline/review-sample.sh --ratio 0.1 --drafts drafts/

# 첫 배치는 50개만 예약 발행

./pipeline/publish-batch.sh --batch 50 --sleep 120

예상 출력은 이 정도면 충분해요.

dataset rows: 50

drafts created: 50

sample selected: 5

publish mode: scheduled

next review date: 2026-05-02

실제로 많이 막히는 건 발행 속도보다 인증 쪽이었어요. rate limit인 줄 알고 sleep만 늘렸는데, 막상 보면 워드프레스 보안 플러그인이 애플리케이션 비밀번호를 막거나, 토큰이 조용히 만료된 경우가 더 많더라고요. 공개 워크플로 감을 먼저 보려면 n8n 블로그 자동화 템플릿: RSS 수집부터 발행까지 전체 플로우처럼 전체 노드 흐름부터 보는 게 낫습니다.

체크리스트도 같이 두세요.

- 데이터셋 한 행이 한 페이지와 1:1로 대응되나요

- 본문에서 변수 치환 말고 고유 문단이 들어가나요

- 샘플 검수에서 제목, FAQ, CTA까지 읽어봤나요

- 예약 발행 간격이 너무 촘촘하지 않나요

제로클릭 시대의 KPI 재정의

프로그래매틱 SEO AI의 성과를 클릭만 보면 실망하기 쉬워요. AI 검색 요약이 늘면서 노출과 인용이 먼저 일어나고, 클릭은 뒤로 밀리거든요. 그럼 프로그래매틱 SEO AI 페이지는 이제 의미 없냐고요? 그건 너무 빨리 포기하는 거예요.

이제는 SEO 지표 옆에 AEO, 즉 AI 답변 인용 최적화 지표를 같이 봐야 해요. 생성형 검색 엔진 최적화(GEO)도 같은 맥락이고요. 클릭만 줄었다고 실패라고 보기보단, 어떤 질문군에서 내 URL이 인용되는지 같이 봐야 판단이 됩니다.

| 예전 KPI | 지금 같이 볼 KPI | 보는 이유 |

|---|---|---|

| 클릭수 | AI 답변 인용 노출 | 클릭 전에 브랜드가 보이는지 확인 |

| 평균 순위 | 질문군 점유율 | AI 검색은 질문 묶음으로 움직여요 |

| 색인 수 | 살아 있는 URL 비율 | 많이 만든 것보다 유지가 중요 |

| 세션 수 | 보조 전환율 | 뉴스레터, 문의, 브랜드 검색 증가 체크 |

그래서 대량 페이지를 계속 늘릴지 말지는 클릭만으로 정하지 마세요. 인용이 붙는 질문군이 생기면 그 페이지 타입은 더 밀어볼 만해요. 이 흐름은 AEO 최적화 실전 가이드: AI 검색에 내 글이 인용되는 7가지 조건에서 바로 이어집니다.

자주 묻는 질문

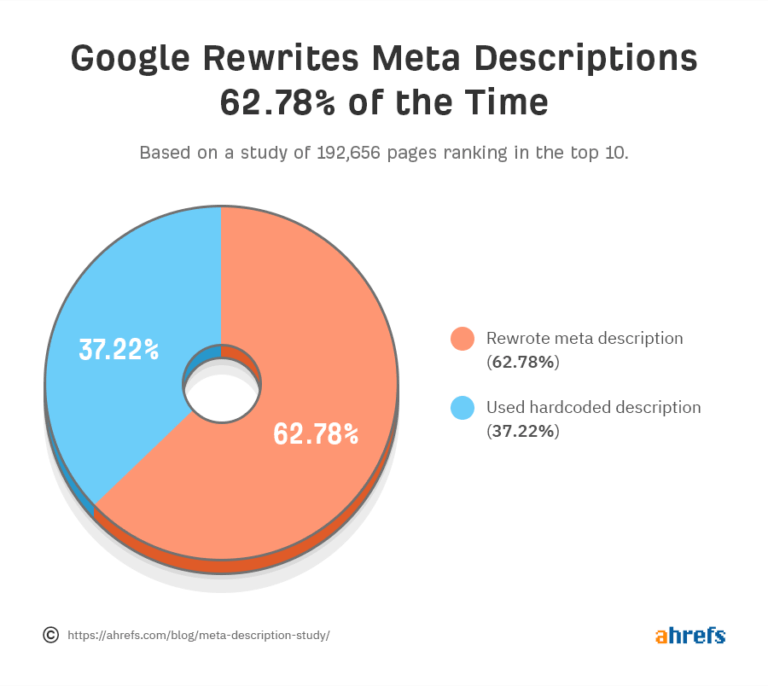

Q1: AI로 수천 페이지 찍으면 구글 패널티를 받나요?

A: AI를 썼다는 이유만으로 바로 맞는 건 아니에요. 구글 공식 가이드는 가치 없는 페이지를 대량으로 만들면 scaled content abuse로 볼 수 있다고 말해요. 그래서 데이터 품질과 샘플 검수가 먼저예요.

Q2: 몇 개까지 한 번에 올려도 괜찮나요?

A: 구글이 “50개까지 안전” 같은 숫자를 준 적은 없어요. 실무에선 50개 안팎으로 먼저 올리고 2주 정도 GSC를 보는 흐름이 관리하기 제일 쉬웠어요. 이건 공식 규칙이 아니라 운영 경험칙입니다.

Q3: Byword도 프로그램매틱 SEO에 쓸 수 있나요?

A: 써볼 수는 있어요. 공식 문서에도 프로그램매틱 빌더, 캠페인, WordPress 연동, API가 잡혀 있거든요. 근데 lower tier에서 매달 많은 페이지를 계속 돌리면 비용 구조가 금방 답답해질 수 있어요.

Q4: n8n으로 WordPress 발행할 때 가장 먼저 어디를 봐야 하나요?

A: 발행 속도보다 인증부터 보세요. 워드프레스 REST API 접근 권한, 애플리케이션 비밀번호, 보안 플러그인 차단 여부 순서로 체크하면 삽질이 줄어요.

Q5: GEO랑 AEO도 같이 해야 하나요?

A: SEO를 버리고 갈 일은 아니에요. 기존 검색에서 색인과 주제 권위를 먼저 만들고, 그다음 AI 답변 인용을 따로 추적하는 식이 현실적이죠. 둘은 대체재보다 보완재에 가까워요.

다음 단계

먼저 자기 도메인에 “한 행이 한 페이지 가치”가 되는 데이터가 100행은 나오는지부터 체크하세요. 그게 되면 첫 배치 50개만 올리고, 안 되면 토픽 권위 블로그 구축: 클러스터 전략으로 트래픽 30배 키우기 쪽으로 바로 방향을 틀면 됩니다.