에이전틱 브라우저 SEO: 클릭 60% 사라진 검색에서 인용되는 법

에이전틱 브라우저 SEO 한 줄 요약

에이전틱 브라우저 SEO, 한마디로 뭐예요?

짧은 답변: 에이전틱 브라우저 SEO는 순위를 조금 더 올리는 잔기술보다, AI 브라우저와 답변 엔진이 내 페이지를 읽고 출처로 붙이게 만드는 기본 세팅에 가까워요. 지금은

robots.txt에서 검색용 봇과 학습용 봇을 나누고,/llms.txt에 작업 단위 요약을 넣고, GA4 대신 서버 로그까지 같이 보는 게 출발선이에요.

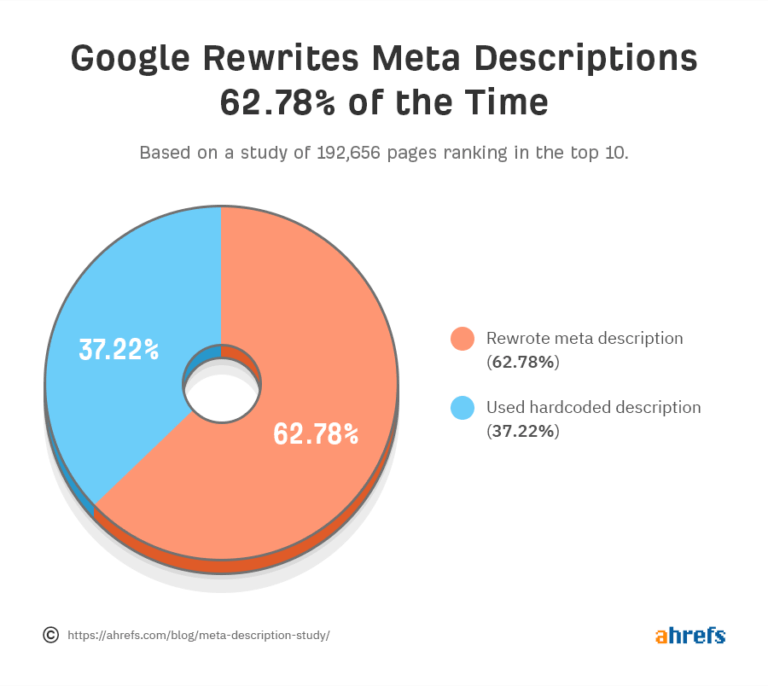

GA4에서 Direct가 갑자기 늘면 보통 브랜드가 세졌다고 생각하죠. 사실 2026년엔 꼭 그렇진 않더라고요. ChatGPT Atlas처럼 브라우저 안에서 열리는 방문은 출처가 흐려지고, Perplexity Comet처럼 리퍼러를 남기는 쪽도 따로 봐야 하거든요. 여기에 Google AI Overviews까지 붙으면서, Ahrefs가 2026-02-04에 업데이트한 분석 글 “Update: AI Overviews Reduce Clicks by 58%”에선 1위 결과 클릭률이 평균 58% 낮아졌다고 짚었어요. 제목에 “클릭 60%”를 쓴 배경이에요.

에이전틱 브라우저 SEO는 이 지점에서 시작해요. 사람 손가락이 누른 클릭만 보지 말고, 에이전트가 읽고 요약하고 인용하는 경로까지 같이 설계하는 거죠. 이 글은 워드프레스든 정적 사이트든 바로 손댈 수 있게, 로그 확인 순서, robots.txt 분기, llms.txt 초안, HTML 구조 체크 포인트를 한 번에 묶어놨어요. 답변 엔진 최적화, 그러니까 AEO 큰 그림이 먼저 필요하면 AEO 최적화 실전 가이드: AI 검색에 내 글이 인용되는 7가지 조건도 같이 보면 좋아요. 특히 “트래픽은 안 보이는데 왜 인용은 느는 것 같지?” 여기서 막히는 분들 기준으로 정리했어요.

클릭은 줄고 인용은 늘어요: 2026 검색판이 바뀐 이유

에이전틱 브라우저 SEO를 하려면 먼저 검색판이 어떻게 바뀌었는지 봐야 해요. 핵심은 순위 → 클릭 하나로 끝나던 흐름이 크롤 → 요약 → 인용 → 늦은 클릭으로 길어졌다는 점이에요.

검색 순위는 비슷한데 클릭만 줄었다면, 나만 그런 걸까요?

2026-04-18 기준으로 지금 시장은 독립 브라우저와 브라우저 안 AI 기능이 같이 달리고 있어요. 이 차이를 안 보고 한 덩어리로 묶으면 대응이 꼬여요.

| 제품/기능 | 형태 | 현재 쓸 수 있는 환경 | 실무에서 보는 포인트 |

|---|---|---|---|

| ChatGPT Atlas | 독립 브라우저 | macOS, Windows/iOS/Android 예정 | 브라우저 기억과 Agent Mode가 붙고, 출처 추적이 흐려지기 쉬워요 |

| Perplexity Comet | 독립 브라우저 | Mac/Windows/iOS/Android | 검색형 유입은 리퍼러가 남는 편이라 로그 추적이 쉬운 편이에요 |

| Gemini in Chrome | Chrome 안 기능 | Chromebook Plus, Mac, Windows 일부 국가 순차 배포 | 현재 탭과 최대 10개 탭 공유로 요약과 비교에 강해요 |

| Copilot Mode in Edge | Edge 안 모드 | Windows, Mac, Edge 모바일 예정 | 별도 앱보다 브라우저 기능에 녹아드는 타입이죠 |

| Opera Neon | 독립 브라우저 | public early access | 실험 속도는 빠르지만 월 $19.90 비용이 들어요 |

여기서 숫자 하나만 잡아도 분위기가 보여요. Ahrefs는 2026-02-04 업데이트에서 AI Overview가 붙은 검색 결과의 1위 CTR, 그러니까 클릭률이 평균 58% 낮아졌다고 봤어요. 반대로 Google은 AI Overviews가 200개+ 국가, 40개+ 언어로 넓어졌고 웹 링크 노출도 같이 가져간다고 밝혔죠. 클릭은 빠졌는데, 읽히는 표면은 오히려 넓어진 셈이에요.

그래서 이제는 “사람이 얼마나 눌렀나”만 보면 반쪽짜리예요. AI 검색 쪽 큰 흐름은 ChatGPT Search SEO: 인용 확률 높이는 7가지 구조에서 같이 보면 더 잘 이어져요.

GA4에 안 찍히는 ChatGPT Atlas 트래픽 잡는 법

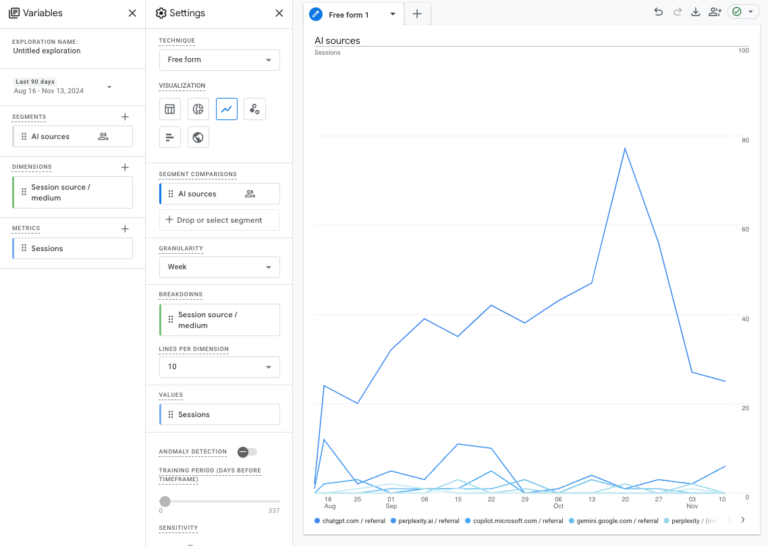

ChatGPT Atlas 트래픽은 분석 도구에서 흐려지고, Perplexity Comet 트래픽은 상대적으로 잘 보이는 편이에요. 그래서 GA4만 보고 있으면 에이전틱 브라우저 SEO 성과를 낮게 잡기 쉽거든요.

Direct가 갑자기 늘었는데 진짜 브랜드 유입인지, 아니면 에이전트 클릭인지 어떻게 가를까요?

MarTech의 GA4 리퍼러 추적 테스트(2026년)를 보면, Perplexity Comet은 perplexity.ai/referral처럼 잡히는 경우가 있었고 ChatGPT Atlas는 Direct나 (not set)로 섞이는 경우가 많았어요. 여기서 말하는 리퍼러는 “어디서 넘어왔는지”를 알려주는 HTTP 출처 헤더예요. 이게 빠지면 GA4는 그냥 Direct로 보내버리죠.

실무에선 순서를 이렇게 가져가면 돼요.

- GA4

Session source/medium에perplexity.ai/referral같은 값이 들어왔는지부터 확인해요. - Direct가 튄 날짜의 상위 랜딩 페이지를 GA4 보고서로 교차해 보세요.

- 웹 서버 로그에서

User-Agent(요청 주체 식별 문자열)도 같이 묶어요. - AI 브라우저 방문은 세션보다 URL 패턴과 시간대가 더 잘 말해줄 때가 많아요.

# 최근 웹 서버 로그에서 AI 검색·에이전트 흔적만 보기

grep -Ei 'PerplexityBot|Perplexity-User|OAI-SearchBot|ChatGPT-User|Claude-SearchBot|ClaudeBot|Googlebot|GoogleOther' /var/log/nginx/access.log | tail -n 50

# 검색용 봇 요청만 날짜별로 묶어 보기

grep -Ei 'PerplexityBot|OAI-SearchBot|Claude-SearchBot' /var/log/nginx/access.log | \

awk '{print $4, $12}' | sed 's/\[//g' | cut -d: -f1 | sort | uniq -c | sort -rn | head

코드 하나 더. 랜딩 페이지 기준으로 보면 더 빨라요.

# 특정 글에 붙은 AI 봇 흔적만 보기

grep -Ei 'agentic-browser-seo|PerplexityBot|OAI-SearchBot|Claude-SearchBot' /var/log/nginx/access.log

“GA4에 안 보이니까 유입이 없는 건가?” 싶을 땐 보통 측정이 덜 된 거죠. 에이전틱 브라우저 SEO를 GA4 숫자 하나로 판단하면 계속 저평가되기 쉬워요. ChatGPT 쪽 흐름은 ChatGPT Atlas SEO: OAI-SearchBot에 인용되는 콘텐츠 만들기랑 같이 보면 연결이 빨라요.

robots.txt와 llms.txt 작성법: AI 검색 최적화 기본 세팅

AI 검색 최적화는 복잡한 기능보다 접근 제어부터 잡는 게 먼저예요. 에이전틱 브라우저 SEO의 출발선이 바로 여기예요. robots.txt는 누가 들어올지 정하고, llms.txt는 들어온 에이전트에게 뭘 먼저 읽을지 정해줘요.

robots.txt: 검색용 봇과 학습용 봇을 따로 다루기

설마 아직 * 하나로 전부 묶어놓고 있진 않죠?

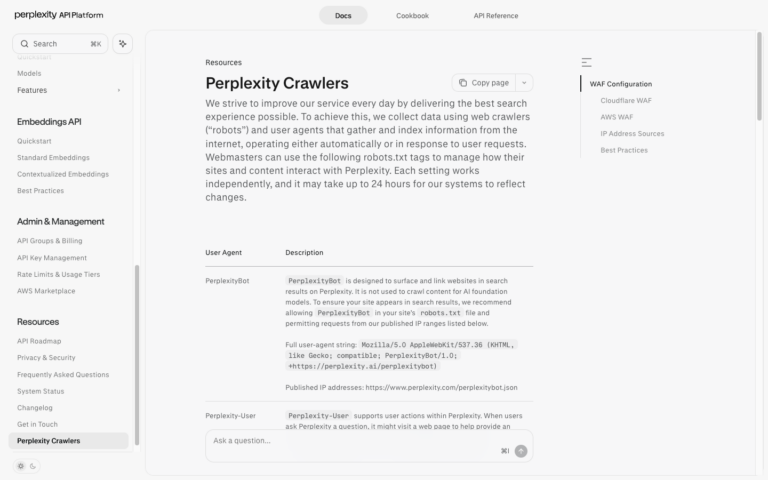

지금은 봇별로 따로 다뤄야 해요. 한 종류가 아니거든요. OpenAI는 OAI-SearchBot, GPTBot, ChatGPT-User를 따로 두고 있고, Anthropic은 ClaudeBot, Claude-SearchBot, Claude-User를 나눠 써요. Perplexity도 PerplexityBot과 Perplexity-User를 분리했죠. Google 쪽은 Googlebot과 Google-Extended 역할이 다르고요. 이걸 한 줄로 막아버리면 검색 인용과 학습 통제를 한 번에 같이 날려버릴 수 있어요.

# robots.txt 시작점 예시

# 검색/인용 쪽은 열기

User-agent: OAI-SearchBot

Allow: /

User-agent: PerplexityBot

Allow: /

User-agent: Claude-SearchBot

Allow: /

User-agent: Googlebot

Allow: /

# 학습 쪽은 필요하면 막기

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: Google-Extended

Disallow: /

이건 시작점이에요. 회원, 결제, 관리자, 장바구니 같은 경로는 별도로 막아야 해요. 특히 사용자 요청 기반 fetcher인 ChatGPT-User, Perplexity-User, Claude-User는 검색용 봇이랑 성격이 달라서 문서 확인을 따로 해야 해요.

llms.txt: 사이트 요약본 한 장으로 인용 길 열어두기

llms.txt는 2024-09-03에 공개된 제안 규격이에요. 쉽게 말하면 사이트 루트에 두는 Markdown 요약본이죠. 만능 버튼은 아니에요. 그래도 “우리 사이트에서 뭘 읽으면 되는지”를 짧게 주는 용도로는 꽤 실용적이에요.

# Example Site

> AI 자동화와 SEO 운영 팁을 다루는 한국어 블로그예요.

읽는 순서:

- 먼저 체크리스트 글

- 그다음 실전 설정 글

- 마지막으로 스키마와 검수 글

## Quick Tasks

- [에이전틱 브라우저 SEO 체크리스트](https://example.com/agentic-browser-seo): robots.txt, llms.txt, 로그 확인 순서

- [워드프레스 SEO 설정](https://example.com/wordpress-seo-setup): 발행 전 기술 SEO 점검

- [FAQ 스키마 예시](https://example.com/faq-schema): 질문형 콘텐츠 구조

워드프레스에서 바로 붙일 생각이면 llms.txt 워드프레스 적용법: Yoast로 켜고 404까지 잡기를 옆에 띄워두는 게 편해요. Perplexity 쪽 인용 흐름은 Perplexity 인용 SEO: AI 검색 상위 노출 3단계도 같이 볼 만해요.

에이전트가 읽는 HTML과 스키마 마크업

에이전트는 화려한 레이아웃보다 앞부분의 의미를 먼저 봐요. 그래서 에이전틱 브라우저 SEO에선 본문 도입, 시맨틱 HTML, JSON-LD 같은 구조화 데이터 형식이 전보다 더 중요해졌어요.

아직도 첫 화면 300줄을 헤더, 배너, 추천글로 채우고 있진 않죠?

Addy Osmani가 2026-04-11에 자신의 블로그(addyosmani.com)에 정리한 글 “Agentic Engine Optimization (AEO)”에서 강조한 포인트가 있어요. 페이지 첫 500토큰 안에 “이게 뭔지, 뭘 할 수 있는지, 시작하려면 뭐가 필요한지”가 들어가야 한다는 거예요. 사람도 같은 페이지를 좋아하죠. 결국 AI만 위한 최적화가 아니라, 군더더기 없는 정보 구조를 다시 잡는 일에 가까워요.

체크리스트부터 짧게 볼게요.

article,section,nav,footer구분을 분명히 둬요.- H1 바로 아래에 Quick Answer를 넣어요.

- FAQ는 질문형 H3와 짧은 답으로 끊어요.

- 가격, 날짜, 작성자, 수정일은 텍스트와 구조화 데이터에 같이 넣어요.

- 클라이언트 자바스크립트 의존을 줄여요.

- CAPTCHA, 무한 스크롤, hover 의존 메뉴는 본문 접근을 막기 쉬워요.

텍스트 브라우저(lynx, 터미널에서 돌아가는 순수 텍스트 브라우저) 시점으로 한 번 보는 것도 꽤 유용해요.

# 텍스트 브라우저 시점으로 본문 앞부분만 확인

lynx -dump -nolist https://example.com/agentic-browser-seo | head -n 60

Cloudflare를 쓰는 사이트라면 Markdown for Agents도 한 번 테스트해볼 만해요. Accept: text/markdown 협상으로 HTML을 Markdown으로 바꿔주는 방식이라, 긴 내비게이션 잡음을 줄이는 데 도움이 될 수 있거든요.

# Cloudflare Markdown for Agents 테스트 예시

curl -H "Accept: text/markdown" https://example.com/agentic-browser-seo

여기까지 왔으면 구조화 데이터도 붙여야죠. JSON-LD 예시는 AI Schema 만들기: Article·FAQ·Breadcrumb JSON-LD 자동 생성 가이드에서 바로 가져다 쓰면 되고, 워드프레스 전반 세팅은 워드프레스 SEO 설정: 설치 직후부터 스키마까지 한 번에 끝내기로 이어가면 돼요.

네이버까지 같이 보려면 최신성과 모바일을 따로 챙겨요

Google 쪽에서 인용되기 좋은 글과 Naver에서 읽히는 글은 겹치는 부분이 많아요. 근데 에이전틱 브라우저 SEO를 챙기면서도 최신성 표시, 모바일 첫 화면, 제목 길이 같은 건 Naver 쪽에서 더 민감하게 체감돼요.

어차피 한국어 글인데, Google만 보고 끝내도 될까요?

아니요, 그렇진 않아요. 국내 트래픽 비중이 남아 있다면 Naver용 운영 습관을 따로 들여야 해요. 복잡한 최적화보다 기본이 먼저예요.

| 체크 항목 | Google 쪽 의미 | Naver 쪽 실무 포인트 |

|---|---|---|

| 발행일/수정일 | 최신성 신호 | 글 목록과 본문에서 날짜가 잘 보이는 게 유리해요 |

| 모바일 첫 화면 | 요약 인지 속도 | 첫 3문장 안에 답이 보여야 이탈이 덜해요 |

| 제목 길이 | SERP 가독성 | 모바일에서 잘리는지 꼭 봐야 해요 |

| OG 이미지 | 공유 품질 | 블로그 카드와 외부 공유 클릭률 차이가 커요 |

| 카테고리/태그 | 문맥 분류 | 과한 태그는 오히려 지저분해 보여요 |

운영 순서도 단순하게 가면 돼요.

- 제목은 키워드가 앞에 오게 잡아요.

- 첫 문단에서 바로 답을 줘요.

- 본문 중간에 표 하나, 체크리스트 하나는 꼭 넣어요.

- 수정했으면

modified_date를 갱신해요. - 발행 뒤엔 Naver Search Advisor 제출까지 묶어요.

메타와 발행 세팅은 AI 메타 설명 만들기: 제목부터 검수까지 워크플로우랑 워드프레스 SEO 한 번에 끝내기 두 글을 같이 보면 거의 정리돼요.

자주 묻는 질문

Q1: 에이전틱 브라우저가 내 사이트를 방문해도 GA4에서 안 보여요. 정상인가요?

A: 네, 정상이에요. ChatGPT Atlas는 리퍼러가 흐려지는 케이스가 있어서 GA4에서 Direct나 (not set)로 섞이기 쉽거든요. GA4만 보지 말고 서버 로그를 같이 봐야 정확한 그림이 나와요.

Q2: llms.txt 만들면 AI 검색 인용이 바로 늘어요?

A: 바로 늘어난다고 단정하면 과해요. llms.txt는 제안 규격이라서, 지금은 “에이전트가 읽기 쉬운 요약본을 준다” 정도로 보는 게 맞아요. 그래도 /llms.txt 하나 없으면 시작선에도 못 선 느낌이 들 수 있어요.

Q3: robots.txt에서 AI 봇을 전부 막아야 하나요?

A: 보통은 전부 막지 않아요. 검색/인용용 봇과 학습용 봇을 나눠서 다루는 편이 실무적으로 낫거든요. 특히 검색 노출이 필요한 글이라면 OAI-SearchBot, PerplexityBot, Claude-SearchBot을 한 번에 막는 건 손해일 수 있어요.

Q4: 스키마 마크업은 아직도 중요한가요?

A: 중요해요. Article, FAQPage, 제품 정보 같은 구조화 데이터가 있으면 에이전트가 페이지 성격을 더 빨리 읽어요. JSON-LD, 그러니까 본문 바깥에 붙이는 구조화 데이터 형식으로 넣는 게 제일 무난해요.

Q5: 광고 클릭 예산이 새는 것도 진짜 신경 써야 하나요?

A: 광고를 크게 집행 중이면 체크해두는 게 좋아요. 브라우저 기반 에이전트가 실제 브라우저처럼 움직일 때, 유입과 클릭 로그가 사람 행동처럼 보일 수 있거든요.

다음 단계

오늘은 robots.txt랑 /llms.txt부터 올려보세요. 그다음 Article·FAQ 스키마 자동화로 넘어가서 Article과 FAQPage까지 붙이면, 에이전틱 브라우저 SEO 기본판은 거의 끝나요. 한 주 뒤에 서버 로그에서 AI 봇 요청이 어떻게 움직이는지 다시 보고, 체감 인용이 늘면 에이전틱 브라우저 SEO 실험을 하나씩 더 올려보는 걸 권해요.

관련 글: 가격 페이지 케이스 스터디 구조

관련 글: AI Overview 순위 보는 법